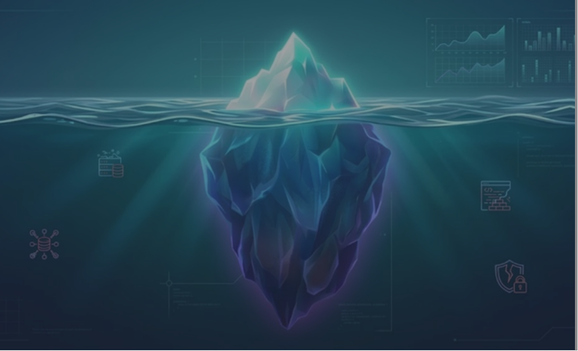

O banco de dados está “no ar”, as queries respondem e as aplicações seguem fluindo. No entanto, a pergunta fundamental não é se o sistema está funcionando hoje, mas qual o nível de esforço e risco necessário para mantê-lo amanhã. Gargalos invisíveis geralmente não se manifestam como erros de sintaxe, mas como débitos técnicos estruturais que comprometem a escalabilidade e a segurança.

A Operação Reativa

O erro mais comum em lideranças técnicas é focar excessivamente na resolução de incidentes (nível operacional) em vez de avaliar a maturidade da arquitetura (nível tático). Quando a equipe gasta 80% do tempo “apagando incêndios” em ajustes pontuais ou recuperando ambientes após falhas que vinham ocorrendo ao longo do tempo e que não foram observadas pela rotina de acompanhamento do seu ambiente. A arquitetura pode ter atingido um teto de maturidade que impede a inovação.

Os Pilares da Maturidade

Para identificar onde os gargalos estão escondidos, precisamos decompor o ambiente através da Matriz de Maturidade, conectada aos seguintes pilares:

- Arquitetura e Escalabilidade: O ambiente suporta um aumento súbito de carga sem degradação linear? A falta de uma estratégia de particionamento de tabelas críticas ou o uso ineficiente de connection poolers (como o PgBouncer) são gargalos que surgem silenciosamente conforme o volume de dados cresce.

- Operação e Previsibilidade: Existe telemetria além do básico “CPU/Memória”? Essa maturidade tática exige, por exemplo: visibilidade sobre o inchaço (bloat) de tabelas, idade de transações, comportamento do autovacuum e desgaste prematuro de IOPS em nuvem. Ambientes sem um Health Check recorrente operam no escuro, ignorando os sinais que antecedem incidentes.

- Segurança e Conformidade: A gestão de permissões segue o princípio do menor privilégio ou o banco ainda é operado por usuários com permissões excessivas? A maturidade aqui avalia a criptografia em repouso e a capacidade de auditoria sem impacto severo na performance do ambiente.

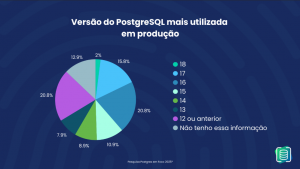

Avaliando o Cenário de Upgrade

Um exemplo claro de maturidade é a forma como a organização lida com upgrades (atualizações de versão). Uma arquitetura madura não encara o upgrade como um “risco a ser evitado”, mas como um processo contínuo de manutenção da saúde do ambiente.

- Upgrade Corretivo (Minor versions): Foco em segurança e estabilidade. A falta de automação para aplicar patches indica baixa maturidade operacional.

- Upgrade de Funcionalidades (Major versions): Avalia-se o ganho técnico real. Migrar para o PostgreSQL 16 ou 17 não é apenas trocar de versão, mas adotar melhorias de funcionalidades como, por exemplo: paralelismo de queries e otimização de I/O que reduzem custos diretos em infraestrutura.

Impacto Estratégico e Tomada de Decisão

Ignorar as lacunas da matriz de maturidade resulta em custos exponenciais. Em ambientes Cloud, a ineficiência técnica é cobrada mensalmente na fatura de recursos desperdiçados. Compreender a posição da empresa na matriz permite transitar de uma postura defensiva para uma liderança que utiliza o PostgreSQL como um ativo estratégico, reduzindo o Time-to-Market de novas funcionalidades por meio de uma base de dados previsível.

O próximo passo

Identificar gargalos invisíveis exige elevar o olhar da operação imediata (apagar incêndios) para a maturidade da arquitetura, utilizando os pilares de segurança, desempenho e escalabilidade como bússola. Ao diagnosticar o estágio atual do PostgreSQL através desta matriz, possibilita-se substituir o ciclo de interrupções por uma gestão previsível e técnica. Em última análise, a maturidade técnica é o que separa bancos de dados que apenas armazenam informações daqueles que sustentam o crescimento sustentável do negócio com baixo risco e custo otimizado.

Conte conosco!

Precisa de um apoio sustentável para os seus ambientes PostgreSQL? Entre em contato conosco!